Vừa qua, các nhà nghiên cứu bảo mật đã phát hiện một lỗ hổng nghiêm trọng trong tính năng Connectors của OpenAI, qua đó cho phép tin tặc trích xuất dữ liệu từ tài khoản Google Drive được kết nối với ChatGPT mà không yêu cầu người dùng thực hiện bất kỳ thao tác nào. Phương thức tấn công này có tên AgentFlayer, được trình diễn tại hội nghị bảo mật Black Hat ở Las Vegas, khiến giới chuyên gia an ninh mạng thực sự lo ngại.

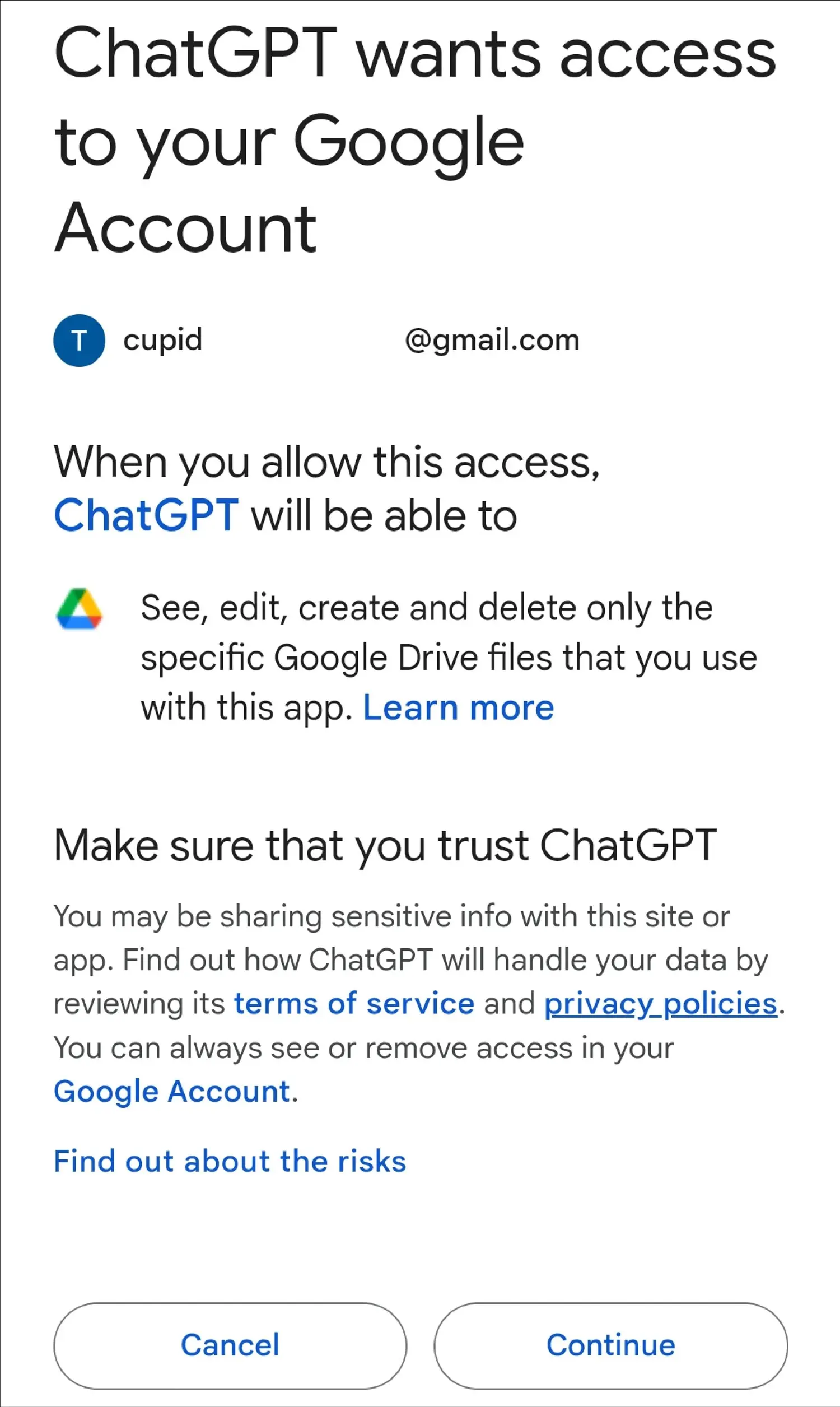

Cụ thể, kẻ tấn công chia sẻ một tài liệu bị “nhiễm độc” lên Google Drive của nạn nhân. Tài liệu này chứa một đoạn lệnh ẩn, viết bằng chữ trắng nhỏ gần như vô hình đối với mắt thường, nhưng được ChatGPT tự động đọc khi quét nội dung theo yêu cầu người dùng. Lệnh ẩn này hướng dẫn AI tìm kiếm và trích xuất các khóa API hoặc dữ liệu nhạy cảm từ Google Drive, sau đó gửi thông tin ra máy chủ bên ngoài qua liên kết Markdown được ngụy trang dưới dạng hình ảnh.

Điều đáng sợ là vụ tấn công không cần người dùng phải mở hoặc tương tác trực tiếp với tài liệu “đầu độc”. Khi người dùng yêu cầu ChatGPT thực hiện một tác vụ liên quan đến tài liệu này, AI sẽ bị đánh lừa để thực thi lệnh ẩn và tiết lộ dữ liệu cá nhân. Đây là một dạng tấn công tiêm mã độc (prompt injection) nguy hiểm, biến trợ lý AI từ một công cụ hỗ trợ thành phương tiện phục vụ kẻ xấu.

Ngay sau khi lỗ hổng được thông báo, OpenAI đã nhanh chóng triển khai các biện pháp khắc phục để giảm thiểu rủi ro. Tuy nhiên, các chuyên gia bảo mật cảnh báo rằng việc cho phép AI tiếp cận sâu vào dữ liệu lưu trữ cá nhân như Google Drive tiềm ẩn nhiều nguy cơ, đòi hỏi các nền tảng phát triển bên thứ ba phải nâng cao các cơ chế bảo vệ an ninh mạng để tránh bị khai thác triệt để.

Nguy cơ này cũng mở rộng ra các nền tảng AI và dịch vụ lưu trữ khác, khi các nhà nghiên cứu đã cho thấy khả năng lợi dụng tương tự để đánh cắp dữ liệu cá nhân và chiếm quyền điều khiển các hệ thống. Người dùng cần nâng cao nhận thức về các quyền truy cập của AI trong các ứng dụng, đồng thời các công ty công nghệ phải có trách nhiệm bảo vệ người dùng trước các mối đe dọa ngày càng tinh vi.