Trong thời đại trí tuệ nhân tạo phát triển mạnh mẽ, công nghệ deepfake voice ngày càng trở nên nguy hiểm khi cho phép giả mạo giọng nói gần như hoàn hảo. Chỉ cần từ 3 đến 10 giây mẫu giọng, kẻ xấu có thể tạo ra âm thanh giống hoàn toàn với giọng nói của người thật, từ cách phát âm, ngữ điệu cho đến những thói quen riêng biệt của từng cá nhân. Điều này khiến nhiều nạn nhân khó lòng phân biệt thật – giả trong những cuộc gọi mạo danh, dẫn tới việc mất tiền oan uổng và trở thành mục tiêu của các chiêu trò lừa đảo tinh vi.

Các vụ lừa đảo thường diễn ra dưới hình thức kẻ gian sử dụng deepfake voice để giả danh người thân, bạn bè hoặc cấp trên trong những tình huống khẩn cấp, gây áp lực tâm lý buộc nạn nhân phải chuyển tiền ngay lập tức. Tại Việt Nam và nhiều quốc gia khác, đã có trường hợp như người mẹ bị lừa tiền khi nhận cuộc gọi giả danh con trai đang gặp tai nạn hoặc giám đốc công ty bị mất hàng trăm nghìn USD do tin tưởng giọng nói giả mạo của ‘sếp’. Việc giọng nói được tái tạo vô cùng sinh động khiến người nghe không nghi ngờ, càng làm tăng tính nguy hiểm của phương thức này.

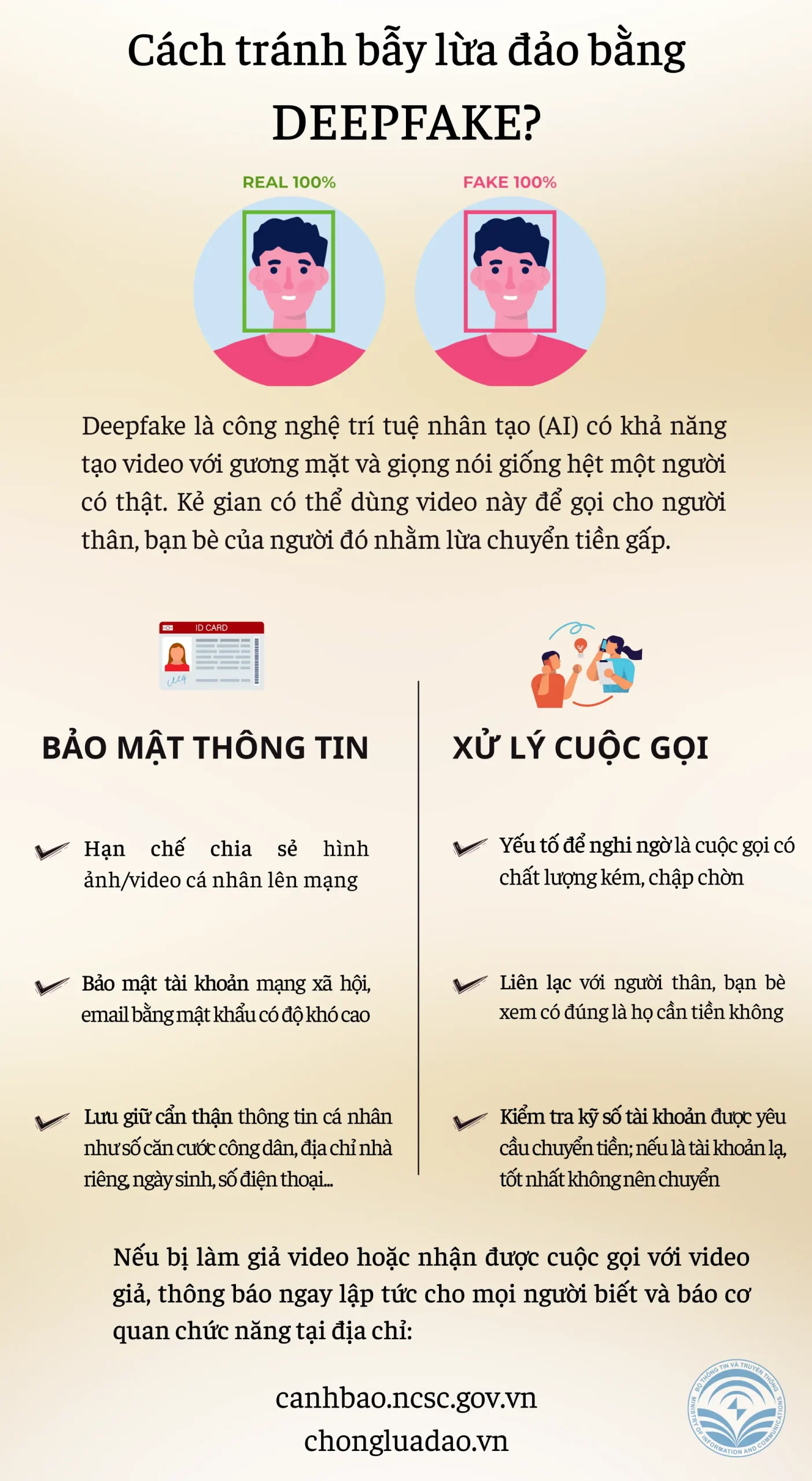

Thêm vào đó, công nghệ deepfake voice không để lại dấu vết trực quan như video nên khó phát hiện và điều tra. Kẻ gian cũng khai thác triệt để việc người dùng thường xuyên để lộ giọng nói trên các nền tảng mạng xã hội, livestream hay hội họp trực tuyến, giúp chúng dễ dàng thu thập mẫu giọng để tạo bản sao nhân tạo rất thuyết phục. Tình trạng này làm dấy lên những cảnh báo nghiêm trọng từ các cơ quan chức năng và chuyên gia về an ninh mạng trong việc bảo vệ danh tính và tài sản cá nhân.

Bên cạnh đó, việc sử dụng AI để giả mạo không chỉ dừng lại ở lừa đảo cá nhân mà còn ảnh hưởng đến lĩnh vực chính trị và an ninh quốc gia. Các vụ việc giả mạo nhân vật cấp cao như Ngoại trưởng Mỹ hay các quan chức khác để tiếp cận thông tin nhạy cảm, chiếm đoạt tài khoản cá nhân đang gây lo ngại mạnh mẽ, buộc các tổ chức quốc tế phải tăng cường các biện pháp an ninh mạng để phòng tránh rủi ro. Đồng thời, nhiều quốc gia đã bắt đầu áp dụng các quy định pháp luật nhằm xử lý nghiêm các hành vi sử dụng công nghệ deepfake để gây ảnh hưởng tiêu cực đến xã hội.

Trước thực trạng đó, người dùng cần nâng cao cảnh giác, không dễ dàng tin tưởng các cuộc gọi hoặc tin nhắn yêu cầu chuyển tiền, đặc biệt khi tình huống gây áp lực khẩn cấp. Đồng thời, các tổ chức nên triển khai công nghệ xác thực đa yếu tố và đào tạo nhân viên về rủi ro từ deepfake để giảm thiểu thiệt hại. Chính phủ và các cơ quan chức năng cũng cần đẩy mạnh tuyên truyền, phát triển luật pháp và công nghệ chống deepfake để bảo vệ an toàn thông tin và tài sản cho người dân trong thời đại số hóa hiện nay.